1. 引言

随着技术的发展,图像和视频相关应用越来越广泛。例如人脸识别、停车场监控、癌症检测等,背后都依赖于图像处理和计算机视觉技术。

这两个领域虽然在技术实现上可能有交叉,但它们的目标和应用场景有本质区别。本文将从定义出发,分析它们的核心差异,并通过实际例子帮助你更好地区分。

2. 计算机视觉 vs 图像处理

我们先分别介绍这两个领域的定义,再深入对比它们的差异。

2.1. 图像处理(Image Processing)

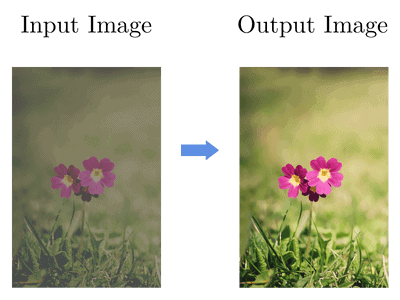

图像处理可以看作是一个“黑盒”操作,它以图像为输入,经过内部变换后输出另一张图像。

输入和输出都是图像,这是图像处理最显著的特征。

举个最简单的例子:调整图像亮度和对比度。

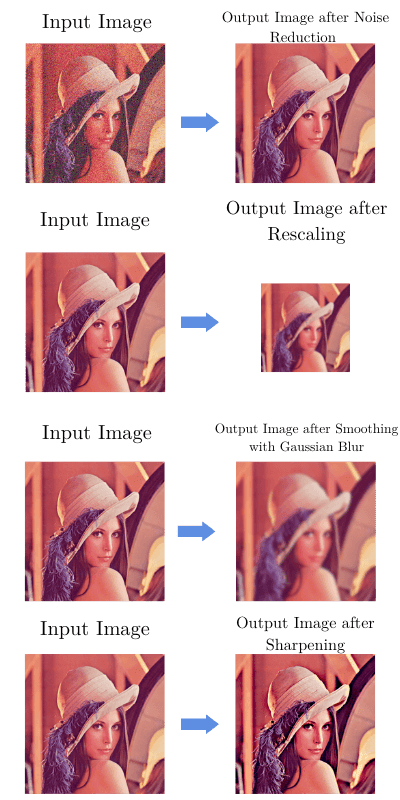

除了亮度调整,图像处理还包括:

- 噪声去除(去噪)

- 图像缩放(rescaling)

- 平滑处理(smoothing)

- 锐化(sharpening)

这些操作的目的通常是为后续任务(如识别、检测)做准备。

✅ 图像处理常用于预处理阶段

✅ 输入和输出都是图像

✅ 不涉及“理解”图像内容

举个实际场景:我们在细胞图像中进行锐化操作,使细胞边缘更清晰,便于后续更精确地分割和分析。

2.2. 计算机视觉(Computer Vision)

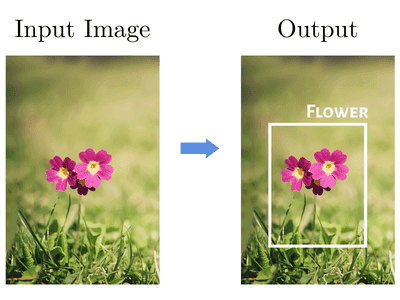

计算机视觉的目标是“理解”图像内容。也就是说,它要识别图像中有什么物体,或者视频中发生了什么行为。

例如,我们想让计算机识别一张图片中是否有鸟,这正是计算机视觉的任务。

以花的图片为例,如果我们做的是目标检测(object detection)任务,输出就不再是图像,而是一个边界框(bounding box)和标签:

除了目标检测,计算机视觉还包括:

- 手写数字分类

- 视频中人脸检测

- 自动驾驶中的车道识别

- 视频行为识别等

✅ 输入可以是图像或视频

✅ 输出可能是标签、边界框、动作识别结果等

✅ 试图模拟人类视觉理解能力

3. 主要区别

| 特性 | 图像处理 | 计算机视觉 |

|---|---|---|

| 输入 | 图像 | 图像或视频 |

| 输出 | 图像 | 标签、边界框、文本等 |

| 是否改变图像属性 | ✅ 是 | ❌ 否(通常) |

| 是否理解图像内容 | ❌ 否 | ✅ 是 |

| 使用阶段 | 通常为第一步 | 通常在图像处理之后 |

3.1. 总结与协作关系

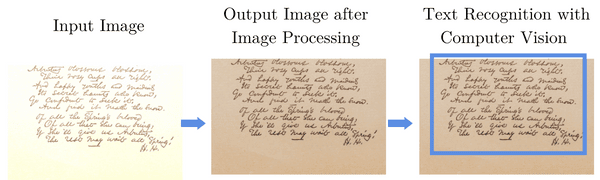

虽然它们有本质区别,但在实际项目中常常协同工作。

举个例子:我们要识别一张模糊的手写数字图像。

- 先用图像处理技术增强对比度,让数字更清晰;

- 再使用计算机视觉模型识别数字内容。

这样组合使用,能显著提升识别准确率。

⚠️ 踩坑提醒:不要混淆这两个阶段的目标。图像处理是“改善图像质量”,不是“理解图像内容”。如果你的任务是识别或分类,那应该用计算机视觉方法。

4. 结论

图像处理和计算机视觉虽有交集,但它们的目标、输出形式和使用阶段完全不同。

- 图像处理:改变图像属性,输出仍是图像

- 计算机视觉:理解图像内容,输出是语义信息(如标签、边界框)

在实际项目中,图像处理往往是计算机视觉任务的前奏。理解它们的差异,有助于我们更合理地设计图像处理流程,提高整体识别性能。