1. 概述

演化算法 是机器学习领域研究了几十年的一类算法。它包含很多子类技术,例如 遗传算法、遗传编程、演化编程 等。这些算法可以用于解决多种问题,从变量优化到设计天线等新工具的结构设计都有广泛应用。

本文将介绍一些在人工智能领域中表现突出的演化算法,并结合实际案例说明其应用场景与优势。

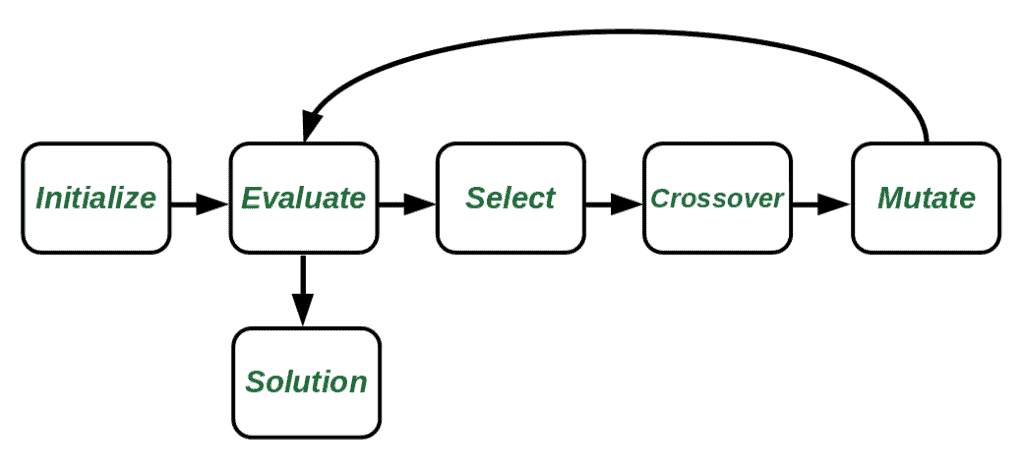

2. 演化算法的基本流程

典型的演化算法流程如下图所示:

理解演化算法中常用的术语有助于我们更快掌握其核心思想:

- 种群(Population):代表候选解的集合。

- 基因型(Genotype):种群中个体的表示方式。

- 代(Generation):演化过程中的一个步骤,通常在这一阶段进行选择、交叉、变异等操作。

演化算法的核心操作包括:

- 选择(Selection):选出表现最好的个体进入下一代。

- 交叉(Crossover):组合不同个体以探索新解。

- 变异(Mutation):引入随机变化以探索新的方向。

最后,还需要一个适应度函数(Fitness Function)来评估个体的优劣,衡量其与目标的接近程度。

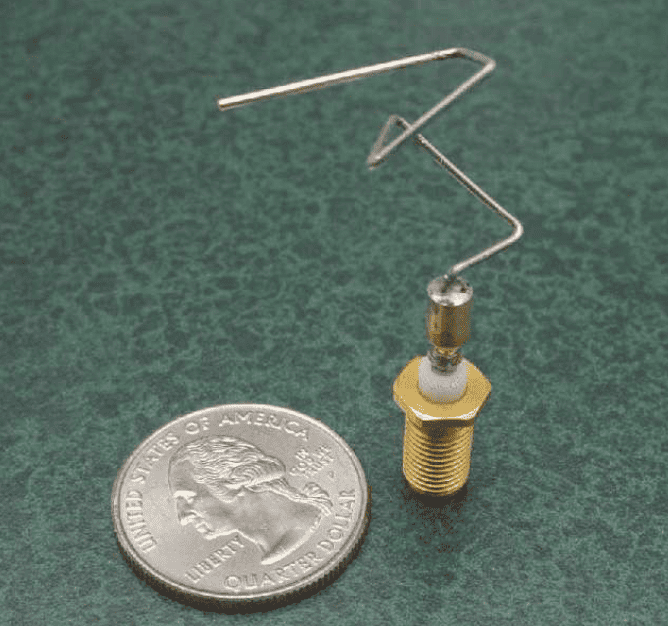

3. 自动天线设计案例

在无线电通信中,有时需要设计具有特定辐射模式的天线。但由于可能的模式组合数量巨大,手动设计几乎不可行。这时演化算法就派上了用场。

NASA 于 2006 年设计的 ST5 航天器天线 就是一个典型应用:

该天线的设计流程从一根初始长度为 0.4 cm 的 Z 轴导线开始,通过以下四种操作控制其生长:

forward(length, radius):沿当前方向添加指定长度和半径的导线rotate-x(angle)、rotate-y(angle)、rotate-z(angle):分别绕三个轴旋转

每一代演化中,适应度函数由以下三个因素的乘积决定:

$$ F = vswr \times gain_{error} \times gain_{smoothness} $$

其中:

- vswr 表示天线与传输线之间的阻抗匹配程度

- gain_error 是增益误差的最小二乘形式

- gain_smoothness 衡量增益随仰角变化的平滑性

通过最小化适应度函数,演化算法可以设计出比手工设计性能更优的非典型天线结构。✅

4. 使用演化算法自动设计神经网络结构

人工智能领域最近兴起的一个方向是 神经网络架构搜索(NAS),它旨在自动化设计神经网络结构。由于神经网络的超参数众多(如层数、学习率、模块结构等),搜索空间非常庞大,演化算法非常适合这种场景。

Google Brain 团队在 2018 年的一篇论文中展示了使用演化算法设计图像分类器的效果,达到了当时最先进的水平。

他们采用的演化流程如下:

- 初始化一个随机架构种群

- 每轮从中随机抽取样本,选择验证集适应度最高的模型

- 对该模型进行变异操作,生成新模型

- 训练并评估新模型,加入种群

- 每加入一个新模型,淘汰最早加入的而非最差的模型,以鼓励探索

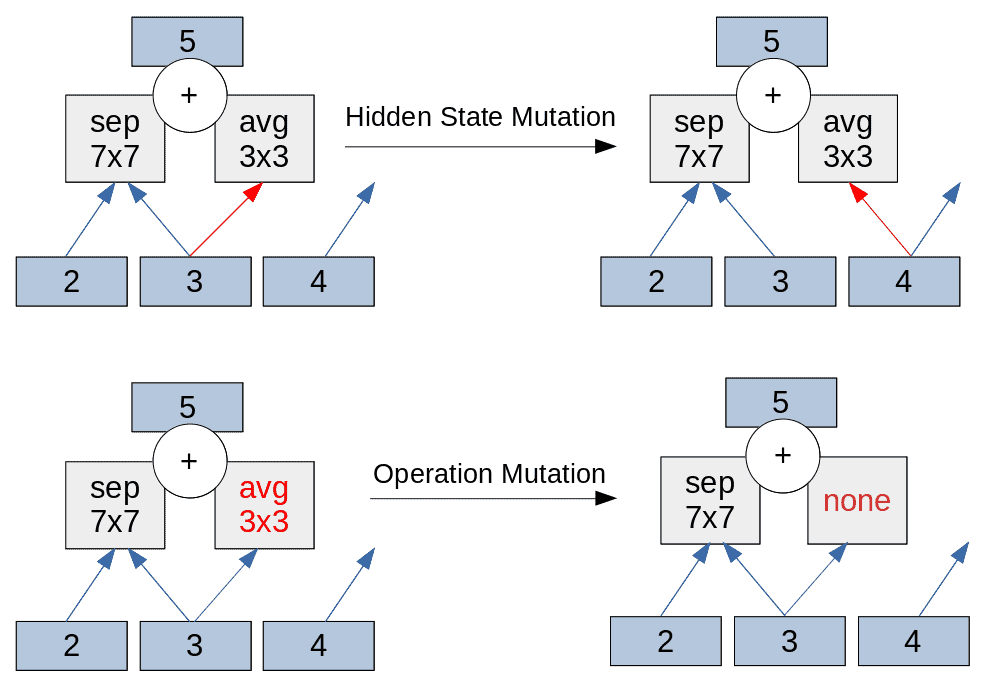

他们采用的变异操作包括以下三类:

- 隐藏状态变异:选择 normal 或 reduction cell,再从五种组合中选一个,替换其中一个隐藏状态

- 操作变异:替换某个操作,如不同大小的可分离卷积、池化等

- 身份变异(Identity):保留原结构不变

适应度函数为分类器的损失函数,目标是最小化该损失。⚠️注意:这类方法虽然效果不错,但计算资源消耗较大。

5. 演化策略 vs. 深度强化学习

强化学习 在 AI 领域发展迅速,尤其适用于算法与环境交互的场景。但其依赖反向传播,训练过程复杂且难以并行化。

演化策略(Evolution Strategies) 则克服了这些问题,仅需前向传播,且天然适合并行计算。OpenAI 的一项研究表明,基于演化策略的算法在优化任务上可以达到与强化学习相近的效果。

其基本思路如下:

- 假设模型参数为 $ w $,目标函数为 $ f(w) $

- 初始随机生成参数向量 $ w $

- 生成多个在 $ w $ 附近的小扰动向量(高斯噪声)

- 评估每个扰动向量的奖励

- 根据奖励加权平均生成新的参数向量

通过这种方式,算法能逐渐向奖励更高的方向演化。适应度函数即为模型的期望奖励。✅这种策略简单高效,适合大规模并行训练。

6. 总结

本文介绍了演化算法的基本流程及其在多个前沿 AI 领域的应用,包括:

- 天线设计:自动设计出非典型但性能更优的结构

- 神经网络架构搜索:使用演化策略设计图像分类器

- 演化策略与强化学习对比:展示其在优化任务中的潜力

总体来看,演化算法在处理大规模、高维度、复杂搜索空间的问题上具有独特优势。虽然计算成本较高,但其并行性和鲁棒性使其成为 AI 领域不可忽视的一股力量。